Índice

Roteiros

- Populações

-

- Estrutura

-

- Dinâmica

-

- Denso Independente

-

- Denso Dependente

-

- Populações Estruturadas

-

- Metapopulações

-

- Uma Espécie

-

- Duas Espécies

-

- Comunidades

-

- Estrutura

-

- Dinâmica e Distúrbio

-

- Dinâmicas Neutras

-

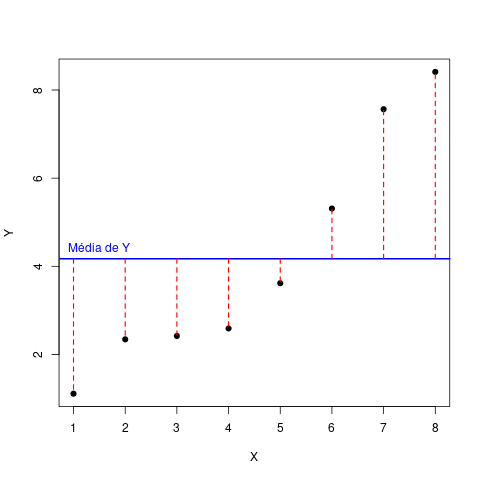

- Matemática e Estatística

-

- Cálculo Integral e Diferencial

-

- Processos Estocásticos

-

Links Externos

Visitantes